De 0,11 megapíxeles a asistentes de redes neuronales: cómo evolucionaron las cámaras en los teléfonos inteligentes

Dispositivos / / January 06, 2021

La cámara en un teléfono inteligente se ha convertido en una parte integral de nuestra vida: con su ayuda, siempre puede capturar un momento importante y compartirlo con los demás. Sin embargo, para que esto se hiciera realidad, se necesitaron 20 años de progreso técnico, una redistribución del mercado de equipos fotográficos y muchas innovaciones. Decidimos recordar cómo la fotografía móvil irrumpió en nuestra vida cotidiana y qué empresas la hicieron simple y accesible.

Los primeros teléfonos con cámara

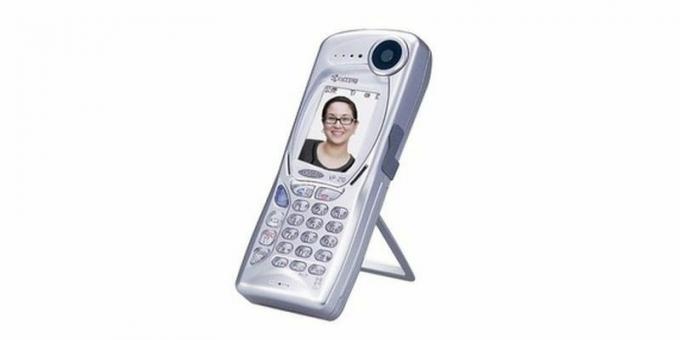

Por primera vez la cámara apareció en el teléfono en 1999: la empresa japonesa Kyocera lanzó el modelo VP-210, que permitía realizar videollamadas. La cámara estaba ubicada al frente y capturó la cara del propietario a una velocidad de 2 cuadros por segundo. También podría tomar selfies con una resolución de 0,11 megapíxeles y almacenarlas en la memoria del dispositivo en una cantidad de hasta 20 piezas.

En los años siguientes, las cámaras móviles se desarrollaron rápidamente bajo el embate de la competencia, y ya en 2004 se alcanzó el hito de 1 millón de píxeles (1 megapíxel). Y en 2005 el mercado se sorprendió con dos modelos que se pueden llamar los primeros teléfonos con cámara: Nokia N90 y Sony Ericsson k750i. Llevaban cámaras con enfoque automático de 2 megapíxeles y tomaban fotografías nítidas, no abstracciones borrosas. Fue entonces cuando la actitud de los usuarios hacia la fotografía móvil comenzó a cambiar: aparecieron grupos temáticos en Flickr, la gente comenzó a intercambiar imágenes recibidas en sus teléfonos y discutirlas.

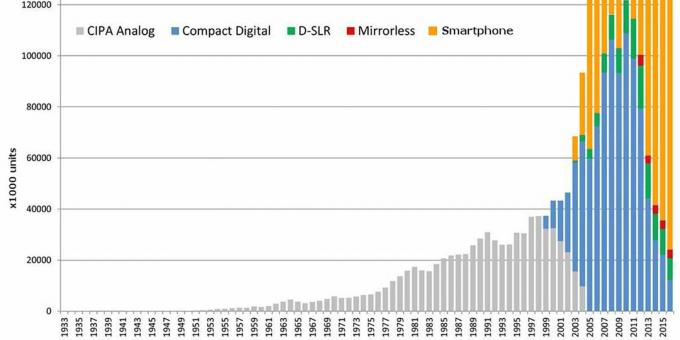

Con cada año subsiguiente, la cantidad de personas que toman fotografías con sus teléfonos ha crecido exponencialmente. El lanzamiento del iPhone en 2007 cambió la actitud hacia los dispositivos monofuncionales: los teléfonos inteligentes comenzaron a reemplazar a los reproductores de MP3 y luego a las cámaras de fotos y video de aficionados.

Leyendo ahora🔥

- 25 divertidos huevos de Pascua de búsqueda de Google que quizás no conozcas

El amanecer de Instagram

El colapso del mercado de las cámaras se produjo en 2010 cuando se lanzó el servicio de Instagram. Los usuarios querían obtener una imagen atractiva de la manera más fácil y rápida posible y publicarla en las redes sociales.

Al mismo tiempo, mejoró la calidad de las cámaras móviles. Presentado en 2011, el iPhone 4s recibió una cámara de 8 megapíxeles y óptica sensible a la luz con una apertura de f / 2.4. Tales características cubrieron la mayoría de las necesidades: presionas un botón, obtienes un marco brillante y lo cargas en Instagram.

Con el tiempo, el procesamiento de imágenes en los teléfonos inteligentes se ha vuelto más agresivo: el contraste, la saturación y la nitidez del contorno tienen prioridad, y la naturalidad de la imagen se desvaneció en el fondo. Pero también ha habido intentos de llevar tecnología profesional a las cámaras móviles. Entonces, Nokia en 2012 fabricó el teléfono con cámara 808 PureView.

El modelo se distinguió por características fenomenales para su época. La resolución de la cámara era de 41 Mp y el tamaño físico del sensor era de 1 / 1,2 ″. También estaba equipado con un obturador mecánico, filtro ND incorporado, lente Carl Zeiss con apertura f / 2.4 y flash de xenón.

Desafortunadamente, otros fabricantes no tenían prisa por seguir el ejemplo de Nokia, confiando en filtros y otras decoraciones.

Más cámaras, buenas y diferentes

En algún momento, las empresas decidieron aumentar la cantidad de cámaras en los teléfonos inteligentes. En 2011, se lanzaron HTC Evo 3D y LG Optimus 3D, que usaban dos lentes cada uno para crear fotografías estereoscópicas. Sin embargo, la tecnología resultó no ser reclamada y los fabricantes se olvidaron de tales experimentos durante varios años.

En la primavera de 2014, el mercado vio el HTC One M8. El teléfono inteligente recibió un módulo auxiliar para medir la profundidad y separar el objeto del fondo. Por lo tanto, la compañía implementó el modo retrato dos años antes que Apple.

En 2016 se produjo un verdadero boom, cuando los mayores fabricantes presentaron sus soluciones. Al mismo tiempo, no había una vista única de lo que necesita el teléfono inteligente. dos cámaras. Por ejemplo, Huawei promovió la fotografía monocromática con el P9, que desarrolló en conjunto con Leica. El LG G5 se basó en shirik, mientras que Apple introdujo un teleobjetivo para fotografía de retrato y zoom óptico en el iPhone 7 Plus.

Al final resultó que, dos cámaras no son el límite. Ahora casi todos los teléfonos inteligentes del mercado están equipados con tres lentes con diferentes distancias focales, así como cámaras para fotografía macro y medición de profundidad.

Características crecientes

La calidad de las cámaras móviles siempre ha estado limitada por limitaciones físicas: el pequeño grosor de la carcasa no permitía equipar los teléfonos inteligentes con ópticas de alta calidad y sensores grandes. Sin embargo, los usuarios exigían mejoras, las empresas intentaban satisfacer sus necesidades.

Así que terminamos con cámaras que sobresalían del cuerpo unos milímetros. Las dimensiones físicas de los sensores también han crecido: si hace cinco años fluctuaban dentro de 1/3 ″, ahora han aparecido en el mercado Samsung Galaxy S20 Ultra y Huawei P40 con sensores 1 / 1.3 ″. Los sensores de imagen han aumentado casi nueve veces, lo que ha mejorado significativamente la calidad de las fotografías.

La gran área de los sensores permitió aumentar la resolución. Las cámaras móviles de 48MP y 64MP se han convertido en la norma, y Samsung y Xiaomi ya han tomado la línea de 108 megapíxeles. Sin embargo, las fotos con tal resolución pesan demasiado, por lo que los ingenieros intentaron un truco: se combina la información de los píxeles vecinos. Esto reduce la resolución, pero a cambio obtenemos menos ruido y un rango dinámico más amplio.

Que sigue

Todas estas innovaciones han convertido a los teléfonos inteligentes en un reemplazo ideal para las jaboneras digitales. Sin embargo, todavía tienen espacio para crecer. E incluso si las características físicas golpean el techo, el software siempre vendrá al rescate.

Ahora la fotografía computacional está ganando impulso: la cámara toma una serie de fotografías y Redes neuronales sobre su base, recogen el marco ideal, suprimiendo el ruido, igualando el brillo y corrigiendo el color. El método se utiliza en Google Pixel 4, iPhone 11, Huawei P40 y muchos otros teléfonos inteligentes. El procesamiento se lleva a cabo de forma automática e imperceptible para el usuario: solo ve el resultado.

A medida que aumenta la productividad, las capacidades de las cámaras se amplían. Ya pueden grabar vídeo y realizar su procesamiento en tiempo real: difuminar el fondo o convertirlo en blanco y negro, dejando los objetos en color. La dirección de la realidad aumentada también se está desarrollando: Apple ya equipó el iPad Pro con un sensor LiDAR para trabajar con aplicaciones AR, y pronto la tecnología también aparecerá en el iPhone.

Las cámaras móviles se están convirtiendo en un complejo de hardware y software, cuyas capacidades no comprendemos completamente. Por eso es más interesante seguir las últimas novedades en este ámbito y probarlas usted mismo.

Leer también📸

- Las mejores cámaras para teléfonos inteligentes de 2019 según DxOMark

- Cómo tomar una buena foto: 6 principios básicos

- 9 ventajas de un smartphone con triple cámara